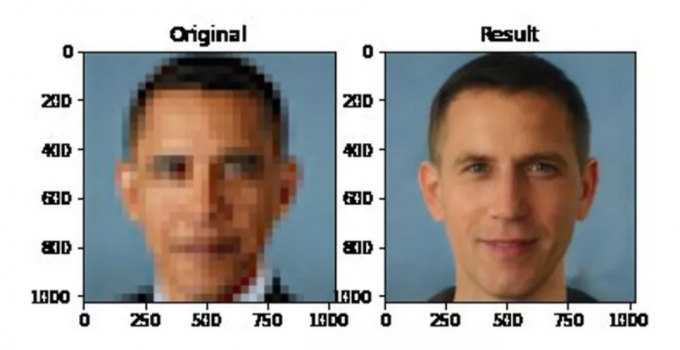

redaksiharian.com – NESABAMEDIA.COM – Setelah diproses oleh sebuah algoritma berbasis AI, foto Barack Obama yang beresolusi rendah berubah menjadi orang kulit putih. Penemuan ini kembali membuktikan adanya bias rasial di dalam teknologi AI (Artificial Intelligence).

Belakangan ini bias rasial tersebut memang tengah menjadi sorotan di Amerika Serikat sejak polisi menggunakan teknologi facial recognition untuk mengawasi pendemo Black Lives Matter.

Algoritma yang digunakan untuk mengolah foto Barack Obama adalah algoritma PULSE yang dibenamkan ke dalam software Face Depixelizer, dan teknik yang diimplementasikan adalah upscaling yang dipadukan dengan machine learning.

Bukan foto Obama saja yang menjadi korban. Dari hasil percobaan yang dilakukan Robert Osazuwa Ness, seorang insinyur riset yang mendirikan altdeep.ai, foto bintang film Lucy Liu dan anggota Kongres Amerika Serikat Alexandria Ocasio-Cortez juga berubah menjadi orang kulit putih.

Menurut Ness, masalah bias rasial sudah umum terjadi pada machine learning sehingga sama sekali tidak mengherankan bagi dirinya. Akan tetapi, kasus kali ini mendapat perhatian lebih karena melibatkan Barack Obama.

Ness mengatakan bahwa Barack Obama adalah sosok yang ikonik sehingga mudah dikenali sekalipun wajahnya tersamarkan oleh rendahnya kualitas foto. Jadi, ketidakmampuan algoritma AI dalam mengidentifikasi wajahnya menjadi contoh bias rasial yang memprihatinkan.

Dalam penjelasannya, para pengembang algoritma PULSE menyatakan bahwa sebenarnya algoritma tersebut tidak pernah dilatih dengan dataset. PULSE menggunakan model generatif StyleGAN, sedangkan StyleGAN itu sendiri dilatih dengan dataset yang diambil dari Flickr.

Di sisi lain, Denis Malimonov selaku pengembang Face Depixelizer menjelaskan bahwa software tersebut tidak ditujukan untuk memulihkan atau memperjelas gambar beresolusi rendah, melainkan hanya untuk menebak struktur wajah seseorang di dalam foto.

Terkait dengan kasus ini, muncul perdebatan sengit di kalangan akademisi, peneliti, dan insinyur yang beberapa diantaranya berlangsung di media sosial seperti Twitter.

Sebagian dari mereka bersikeras bahwa yang menjadi permasalahan adalah dataset yang digunakan dalam melatih algoritma, sebagian lainnya menganggap bahwa sumber masalahnya jauh lebih pelik daripada sekedar dataset dan algoritma.

Terlepas dari apa pun yang menjadi penyebabnya, selama masalah bias rasial masih ada, maka penggunaan AI untuk mengenali wajah dalam penyelidikan kasus kejahatan harus dihentikan atau setidaknya diawasi dengan regulasi yang ketat.

EDITOR: MUCHAMMAD ZAKARIA